英伟达AI生态增长逻辑:基于云厂商资本支出的产业验证模型

人工智能产业的发展逻辑往往遵循“基础设施先行,应用随之爆发”的规律。基于这一假设,我们可以通过分析云服务厂商的资本支出趋势,来验证英伟达作为算力核心供应商的增长潜力。从近期公布的数据来看,全球四大超大规模云厂商全年的资本支出合计接近7000亿美元,这一庞大的资金池直接转化为对高性能算力芯片的强劲需求。

逻辑推理显示,英伟达的营收增长与其客户群体的资本开支呈现高度正相关。第四季度数据中心业务的爆发式增长,正是此前云厂商大规模建设AI基础设施的直接结果。当Meta、微软、谷歌等科技巨头持续加码AI基础设施时,英伟达作为核心硬件供应商,通过提供GPU、CPU及网络产品,实际上充当了全球AI工业革命的“卖铲人”。

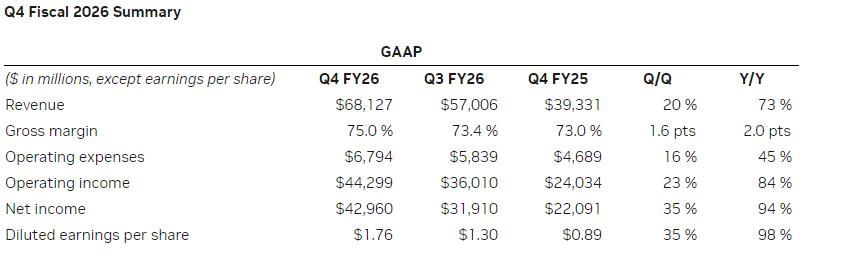

在实验设计层面,我们可以通过对比不同财季的毛利率与研发投入来观察其商业模式的可持续性。本季度GAAP毛利率达到74.9%,这显示出其在高端算力市场具备极强的议价能力与技术壁垒。通过与Anthropic、礼来等头部企业的深化合作,英伟达不仅巩固了在互联网行业的地位,更成功将触角延伸至生物医药、工业制造等垂直领域,这种跨行业的生态验证进一步夯实了其增长基本面。

从结果分析来看,智能体AI的兴起正在成为算力需求的新拐点。随着推理任务复杂度的提升,传统的通用计算架构已难以满足需求,这为英伟达的专用算力平台提供了广阔的市场空间。无论是Blackwell还是Rubin平台,其核心价值在于将推理成本降低至商业可接受的水平,从而驱动AI应用从实验阶段迈向大规模生产阶段。

智能体应用场景对算力需求的驱动逻辑

智能体AI的广泛应用,本质上是对算力吞吐量与响应速度的双重考验。在智能体运行过程中,模型需要实时处理海量数据并进行复杂推理,这要求算力平台具备极高的并发处理能力。英伟达通过NVLink技术实现的互联架构,有效解决了多GPU协同工作时的通信损耗,为复杂智能体的实时响应提供了物理基础。

推理成本的边际效应分析显示,随着推理Token成本的降低,企业运行AI智能体的经济可行性显著增强。当成本下降至临界点以下时,原本受限于预算的各类应用场景将出现爆发式增长。这种成本优化不仅是技术进步的体现,更是推动AI商业模式从“昂贵的尝试”向“主流的生产工具”转化的关键变量。

结论应用表明,全球AI算力市场正处于从“训练为主”向“推理与训练并重”的转型期。未来的市场竞争将不再局限于单一节点的算力性能,而是取决于谁能构建更高效的算力调度网络与生态系统。对于投资者与行业参与者而言,关注算力基础设施的资本开支流向与技术路线图,将是预测未来科技产业增长趋势的核心依据。